【本報悉尼訊】在人工智能AI技術浪潮衝擊傳統司法體系之際,新州首席大法官貝爾提出全澳最嚴格AI管控措施,對律師、無代理的訴訟當事人和法官使用生成性人工智能實施了部分禁令。相較之下,維州最高法院僅要求對AI輔助證據「特別謹慎」,新州政策被法律界形容為「AI緊急煞車」,被視為司法系統對「科技巨頭數據霸權」的正面反制。

在新州最高法院成立200周年之際,貝爾將生成式AI列為司法系統「世代級挑戰」。

貝爾說,審判是人類的任務,當審判權被交託給機器,民主制度的經緯將被撕裂,掌握生成式AI程序的大型企業,能通過數據篩選權無形影響司法系統,這種演算法黑箱」必須被嚴格審視。

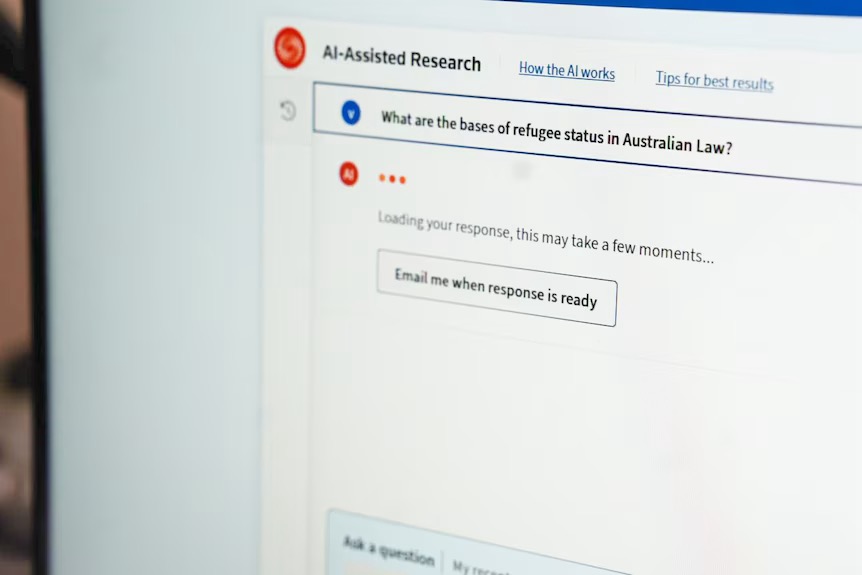

悉尼資深大律師克萊恩展示了AI工具如何將3小時法律檢索壓縮至3分鐘。

他說,AI像個聰明但粗心的實習生,會遺漏關鍵判例、誤解法律原則,最危險的是,這些錯誤被AI包裝得好像已經經過了嚴謹論證。

克萊恩引用了2023年轟動全球的「ChatGPT虛構判例門」,該案例中,美國兩名律師因仰賴AI編寫訴狀,不慎引用6個完全不存在的聯邦判例,遭法庭處以5,000美元罰款並登上全國新聞頭條。

他說,AI的可怕在於,它的說服力與真實判決毫無二致,此類事件若發生在新州法院,可能動搖公眾對司法系統的根本信任。

去年11月新州高院頒布的指引採取「強硬保守路線」,核心精神在於捍衛司法程序的「人類主體性」,明確禁止使用ChatGPT等工具生成宣誓書、證人陳述與品行證明書,亦不得藉AI強化、弱化或扭曲證詞內容。

貝爾說,現在AI生成的證詞與文件已達高度擬真水平,當法庭上出現看似真實卻完全虛構的證據,整個司法機制的公信力將土崩瓦解。

儘管現行制度要求文件提交者簽署未使用AI聲明,不過,貝爾坦言監管存在技術盲區,主要依賴法律從業者的誠信,但隨著AI偽造能力進化,複雜程度不斷提高,辨認是否AI生成也成為法院面臨的挑戰之一,未來可能需要引入數字鑒別機制。

根據新規,律師仍可使用AI輔助撰寫法律意見書,但須逐條核實引述判例的真實性與關聯性,法官則被全面禁止使用AI編輯或校對判決書。

不過,面對法律界反彈聲浪,貝爾大法官1月9日放寬了禁令,允許律師事務所使用「客製化AI系統」處理受封口令保護的敏感資料(如未成年證人姓名、商業機密),前提是資料不得用於AI訓練或他案。此舉引發業界激烈論戰。

然而,克萊恩質疑大型律所的資料安防護能力,對此,貝爾說,修訂版已要求客製化AI設置「嚴格隱私協議」,且所有使用方必須簽署具有法律效力的保密協定。

新州該政策推出之際恰逢歐盟通過法律要求司法AI系統須符合「透明度與人類監督」標準,而中國最高人民法院此前也頒布了關於規範人工智能司法應用的意見」,嚴禁AI直接生成裁判文書。

新州律師協會主席鮑爾說,法律界正形成「謹慎擁抱派」與「全面防禦派」兩大陣營,如何在數字變革中守住程序正義,將是未來十年全球司法界的共同課題。(子力)